Ещё каких-то пять лет назад создание даже короткого видеоролика требовало недюжинных усилий — нужны были дорогостоящие программы, навыки монтажа и львиная доля свободного времени. Обыватель, далёкий от мира видеопродакшена, мог разве что грезить о красивых роликах, снятых «как в кино». А профессионалам за каждую секунду анимации приходилось платить часами рендеринга. И вот на сцену вышли нейросети, способные генерировать видео буквально из текстового описания или статичной картинки. Среди них особый интерес вызывает Runway — платформа, которая довольно быстро завоевала репутацию одного из самых мощных инструментов в своём классе. Но чтобы получить от неё действительно впечатляющий результат, а не размытое нечто на три секунды, стоит разобраться в нюансах работы с сервисом от начала и до конца.

Что такое Runway и почему о нём столько шума?

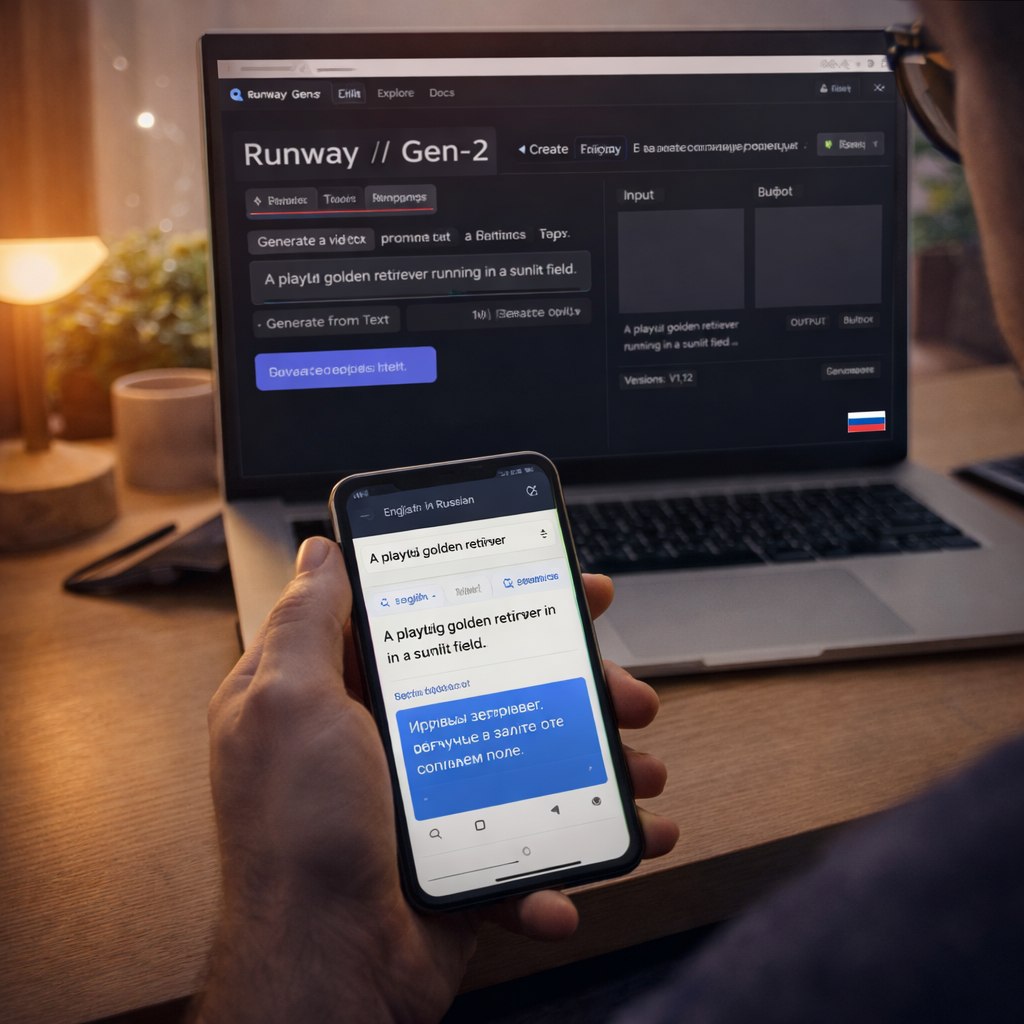

Runway ML — это веб-платформа, выросшая из исследовательского проекта и превратившаяся в полноценный творческий комбайн. Изначально команда разработчиков сосредоточилась на инструментах для работы с изображениями, но настоящий взрыв популярности случился после запуска модели Gen-2, а затем и Gen-3 Alpha. Дело в том, что именно эти модели научились превращать текстовый промт или фотографию в движущуюся картинку с поразительной детализацией. Конечно, до полнометражного фильма тут далеко, однако для коротких клипов, рекламных тизеров, прототипов и просто творческих экспериментов сервис подходит отлично. К слову, Runway активно используют не только энтузиасты — к платформе тяготеют и серьёзные продакшен-студии, и рекламные агентства. Ведь экономия времени и бюджета при создании визуального контента получается ощутимая.

Регистрация и первое знакомство с интерфейсом

Начать нужно с самого банального — регистрации аккаунта. На официальном сайте runwayml.com процесс занимает пару минут: электронная почта, пароль, подтверждение через письмо. Можно авторизоваться и через аккаунт Google, что ещё быстрее. После входа новичка встречает довольно лаконичный дашборд, который на первый взгляд не пугает обилием кнопок. Основное рабочее пространство расположено в центре экрана, а инструменты сгруппированы в левой панели. Нужно отметить, что бесплатный тариф даёт ограниченное количество кредитов (около 125 на момент написания статьи), и каждая генерация съедает определённую порцию. Не стоит разбрасываться ими на тестовые запросы «просто чтобы посмотреть», иначе кошелёк кредитов опустеет раньше, чем появится что-то стоящее. Впрочем, платные тарифы стартуют от двенадцати долларов в месяц и не слишком бьют по бюджету, особенно если генерация видео — регулярная задача.

Какой режим генерации выбрать?

Вот тут начинается самое интересное. Runway предлагает несколько способов создания видео, и выбор зависит от того, что именно лежит в основе — текст, изображение или уже готовый ролик. Первый вариант — «Text to Video». Суть проста: пользователь пишет текстовое описание сцены, а нейросеть интерпретирует его и выдаёт короткий клип продолжительностью от четырёх до десяти секунд. Второй режим — «Image to Video» — работает иначе: за отправную точку берётся загруженная картинка, и модель «оживляет» её, добавляя движение камеры, анимацию объектов или изменение освещения. А третий путь — «Video to Video» — позволяет трансформировать уже существующий ролик, накладывая на него стилистические фильтры или меняя окружение. Для большинства задач львиная доля пользователей тяготеет к первым двум режимам, и именно на них стоит сосредоточиться в первую очередь.

Нереальный визуал и кинематографичное видео в пару кликов 🎬

Нужен крутой концепт-арт, реалистичная анимация или профессиональный апскейл? Теперь у вас есть единый доступ к лучшим визуальным нейросетям планеты: Midjourney, Runway, Kling и Sora. Улучшайте качество готовых роликов до максимума с помощью встроенных ИИ-инструментов. Никаких сложных настроек, мощного ПК или зарубежных карт. Всё работает прямо в браузере или в Telegram-боте!

Откройте новые горизонты для творчества. Жмите на ссылку, регистрируйтесь и создавайте шедевры 👉 https://clck.ru/3RNCRL

Составление промта: искусство описать то, чего ещё нет

Задача не из лёгких. Ведь от того, насколько точно и грамотно сформулирован текстовый запрос, зависит буквально всё — от качества картинки до логики движения. Многие считают, что достаточно написать «красивый закат на море» и нейросеть сама додумает остальное. Но на самом деле результат при таком размытом промте окажется непредсказуемым. Гораздо эффективнее работает подход, при котором описание разбивается на несколько смысловых слоёв. Сначала стоит указать основной объект сцены — кто или что находится в кадре. Затем — действие: что именно происходит, как движется камера, куда направлен свет. Ну и, наконец, стиль и настроение: кинематографичный, мрачный, пастельный, в духе документального фильма. К тому же нейросеть лучше реагирует на конкретику. Вместо «собака бежит» стоит написать что-то вроде «golden retriever running through a wheat field at golden hour, slow motion, cinematic lens flare». Да, промты на английском языке работают стабильнее и точнее — это связано с тем, что модель обучалась преимущественно на англоязычных данных.

Настройки перед генерацией: тонкости, которые решают всё

Кнопка «Generate» так и манит, однако не стоит торопиться. Перед запуском стоит задуматься о параметрах, спрятанных в дополнительных настройках. Один из самых важных ползунков отвечает за степень свободы модели — иногда его называют «creativity» или «motion amount». Чем выше значение, тем активнее нейросеть будет добавлять движение и импровизировать. Для спокойных, атмосферных сцен (рассвет над озером, дым от камина) этот параметр лучше выставлять в районе тридцати-сорока процентов. А вот для динамичных экшн-кадров — семьдесят и выше. Кроме того, при работе в режиме «Image to Video» появляется возможность задать направление камеры: горизонтальный панорамный проход, вертикальный тилт, наезд или отъезд. Это же правило касается и длительности: по умолчанию генерируется ролик на четыре секунды, но можно увеличить до десяти (правда, кредитов уйдёт больше).

Стоит ли использовать референсные изображения?

Безусловно. И вот почему. Когда нейросеть получает только текст, она вынуждена «придумывать» визуальный мир с нуля, опираясь на свои внутренние представления. Результат бывает великолепным, но чаще — непредсказуемым. А если загрузить картинку-референс, модель цепляется за конкретные цвета, формы и композицию, что делает итоговый ролик куда более управляемым. Особый интерес вызывает приём, когда для референса берётся кадр, созданный в другой нейросети — например, в Midjourney или DALL-E. Получается своеобразная цепочка: сначала генерируется идеальная статичная картинка, а затем Runway «вдыхает» в неё жизнь. Тем более что качество исходного изображения напрямую влияет на детализацию видео. Размытую, низкокачественную фотографию нейросеть тоже оживит, но результат вряд ли порадует.

Первая генерация: чего ожидать и как не разочароваться?

После нажатия заветной кнопки начинается ожидание. Обычно процесс занимает от тридцати секунд до двух минут (зависит от нагрузки на серверы). И вот ролик готов. Что бросается в глаза первым делом? Скорее всего — лёгкая нереальность происходящего. Движения могут быть чуть замедленными, текстуры — слегка «плывущими», а мелкие детали вроде пальцев рук или надписей на вывесках — деформированными. Это нормально. Ведь даже самые продвинутые модели пока не научились безупречно работать с анатомическими подробностями и текстом в кадре. Ложка дёгтя, с которой стоит смириться. Но общий антураж, настроение и динамика в удачных генерациях выглядят впечатляюще — настолько, что неподготовленный зритель вполне может принять ролик за снятый на камеру.

Как улучшить результат: итерации и «Extend video»

Первый блин редко бывает комом, но идеальный результат с первой попытки — тоже большая редкость. Поэтому опытные пользователи работают итерационно. Нужно отметить, что Runway позволяет генерировать несколько вариантов по одному промту — достаточно запустить процесс повторно, и нейросеть выдаст совершенно другую интерпретацию. Иногда хватает трёх-четырёх попыток, чтобы получить что-то действительно стоящее. А если ролик нравится, но хочется сделать его длиннее, выручит функция «Extend video». Она берёт последний кадр сгенерированного клипа и продолжает движение дальше. Правда, есть подводные камни: при каждом продлении нейросеть может немного «забывать» исходный стиль, и к третьему-четвёртому удлинению картинка начинает дрейфовать. Не стоит перебарщивать — два-три продления обычно предел, за которым качество заметно падает.

Постобработка и экспорт готового ролика

Скачанный ролик — это ещё не финальный продукт. Само собой, для личных экспериментов сойдёт и так, но если видео планируется использовать в рекламе, презентации или на YouTube, без постобработки не обойтись. Runway позволяет скачать файл в формате MP4 с разрешением до 1080p, что довольно неплохо для большинства задач. Далее ролик стоит пропустить через видеоредактор — будь то DaVinci Resolve, Premiere Pro или даже CapCut для быстрого монтажа на смартфоне. На этом этапе добавляются звук (музыка, голосовое сопровождение, шумы окружения), цветокоррекция и переходы между сценами. Кстати, именно добавление звуковой дорожки творит чудеса: немой ролик воспринимается как черновик, а тот же клип с грамотно подобранным саундтреком — как готовый продукт.

Сколько стоит эта магия?

Вопрос бюджета всплывает неизбежно. Бесплатный план покрывает примерно десять-пятнадцать коротких генераций, после чего придётся либо ждать обновления кредитов, либо переходить на платную подписку. Стандартный план за двенадцать долларов в месяц даёт 625 кредитов, чего хватает на несколько десятков роликов. Для серьёзной работы существует Pro-подписка за двадцать восемь долларов, которая не сильно ударит по кошельку профессионала, зато снимет большинство ограничений по качеству и скорости. Ну, а для студий и команд предусмотрены корпоративные тарифы с индивидуальным расчётом. Стоит ли вообще тратить деньги? Если генерация видео экономит хотя бы пару часов работы оператора или моушн-дизайнера — вложение окупается моментально.

Типичные ошибки новичков

Одна из самых распространённых проблем — слишком короткий и общий промт. Фраза «a man walking» выдаст нечто среднестатистическое и невнятное. Другая частая оплошность — попытка уместить слишком много действий в один запрос. Нейросеть плохо справляется со сценами, где одновременно происходят три-четыре разных события: человек бежит, за ним летят птицы, на горизонте взрывается вулкан, а камера при этом вращается. Результат — визуальная каша. Лучше разбить сложную сцену на несколько простых генераций, а потом смонтировать их в редакторе. Отдельно стоит упомянуть ожидания относительно лиц: нейросеть до сих пор не всегда справляется с мимикой и выражением глаз, поэтому крупные планы с людьми — это всё ещё лотерея. Да и с текстом в кадре пока беда. Надпись на плакате, номер дома, вывеска магазина — всё это с высокой вероятностью превратится в набор бессмысленных символов.

Что насчёт авторских прав?

Вопрос неоднозначный. Согласно условиям Runway, контент, созданный на платных тарифах, принадлежит пользователю — его можно использовать в коммерческих целях. Однако с бесплатным планом ситуация несколько сложнее: лицензия ограничивает коммерческое применение. Этот нюанс стоит учитывать заранее, особенно если видео планируется монетизировать. К тому же правовое поле вокруг AI-генерированного контента продолжает формироваться, и то, что допустимо сегодня, через год может оказаться в серой зоне. Так что щепетильным в юридических вопросах пользователям не помешает заглянуть в актуальную версию пользовательского соглашения на сайте платформы.

Нейросетевая генерация видео — это не далёкое будущее, а инструмент, который уже стоит на ногах и с каждым обновлением становится всё увереннее. Runway в этом процессе занимает одну из лидирующих позиций, и разобраться с платформой вполне реально за один вечер. Несколько пробных генераций, пара скорректированных промтов, немного постобработки — и первый добротный ролик готов. А дальше начинается самое захватывающее: собственные эксперименты, поиск авторского стиля и тот момент, когда нейросеть из непонятной игрушки превращается в надёжный рабочий инструмент. Удачи в первых генерациях — результат точно порадует.