Ещё пять-шесть лет назад генерация видео по текстовому описанию казалась сюжетом из научной фантастики, а сами ролики — если кому-то удавалось их получить — напоминали скорее психоделический калейдоскоп, чем осмысленный визуальный ряд. Буквально за пару лет ситуация перевернулась с ног на голову: нейросети научились создавать движущиеся картинки, от которых у неподготовленного зрителя перехватывает дыхание. Львиная доля заслуг в этой гонке принадлежит компании Runway, чей продукт Gen стал своего рода спасательным кругом для тысяч контент-мейкеров, дизайнеров и маленьких продакшн-студий, которым грандиозные бюджеты на съёмки только снились. Но чтобы не путать маркетинговые обещания с реальными возможностями, стоит разобраться, что же этот инструмент умеет на самом деле.

Что скрывается за названием Runway Gen?

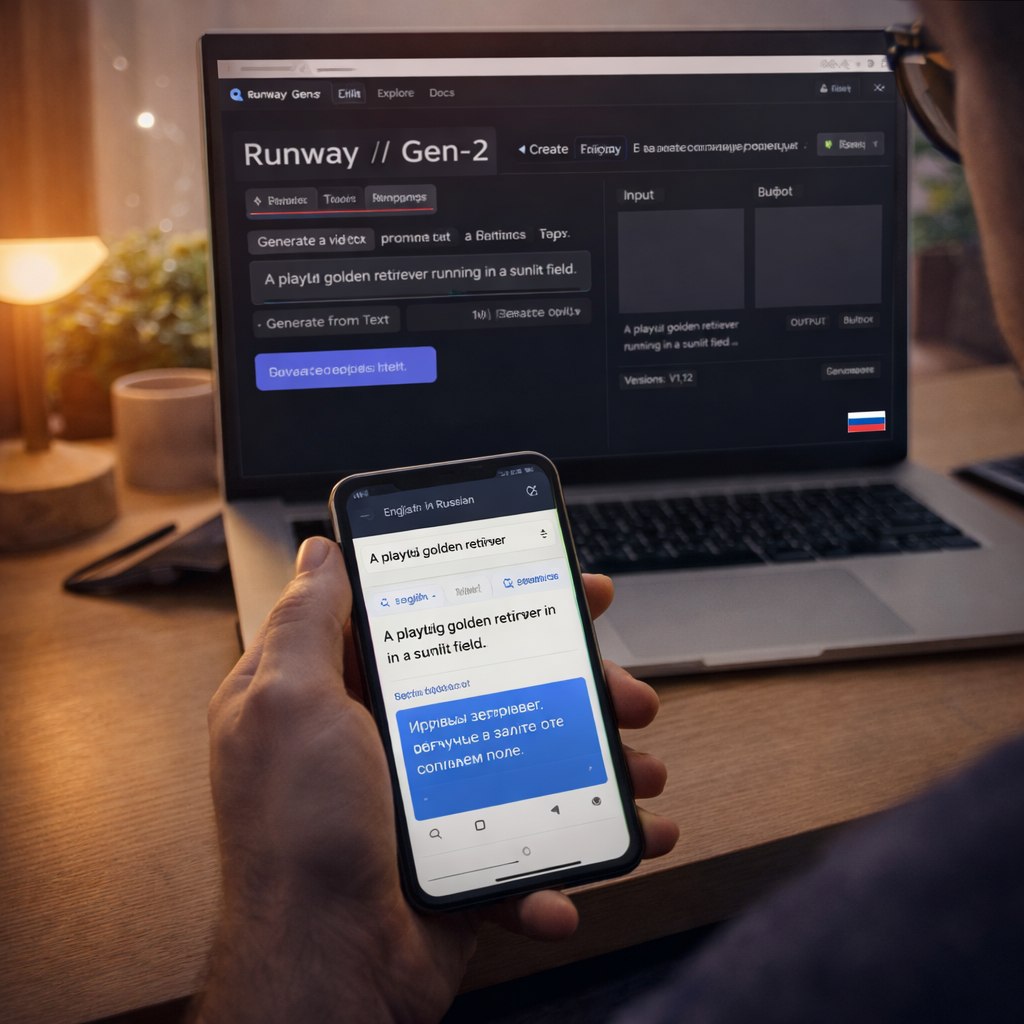

Runway — это не просто нейросеть, а целая экосистема для работы с медиаконтентом, выросшая из стартапа, основанного в 2018 году выпускниками Нью-Йоркского университета. Первые версии платформы тяготели к экспериментальным инструментам для художников: удаление фона, стилизация изображений, несложная ретушь. Всё изменилось с появлением модели Gen-1, а следом — Gen-2 и Gen-3 Alpha. Именно они приковали внимание широкой публики. Дело в том, что эти модели впервые позволили генерировать видеоролики длительностью от четырёх до десяти секунд на основе текстового промта или статичного изображения. Казалось бы, десять секунд — мелочь. Однако для короткого рекламного формата, тизера или вставки в презентацию этого хватает с лихвой. А если склеить несколько таких фрагментов, получается вполне цельная история.

Генерация видео из текста: магия или ремесло?

Пожалуй, самая обсуждаемая функция. Пользователь вводит текстовое описание — допустим, «закатное солнце над океаном, камера медленно движется вперёд, на горизонте силуэт парусника» — и через пару минут получает готовый клип. Звучит впечатляюще? Безусловно. Но есть нюансы. Качество результата напрямую зависит от того, насколько скрупулёзно составлен промт. Расплывчатые формулировки вроде «красивый пейзаж» выдают довольно посредственную картинку, тогда как детализированное описание с указанием стиля камеры, освещения и настроения творит чудеса. К слову, Gen-3 Alpha поддерживает описание движения камеры — панорамирование, наезд, облёт объекта, — и это выводит результат на совершенно иной уровень. Многие считают, что нейросеть сама «понимает» замысел автора, но на самом деле без грамотного промта даже самый мощный алгоритм выдаст посредственность.

Превращение картинки в движение

Отдельно стоит упомянуть режим Image-to-Video. Суть его довольно проста: загружаешь статичное изображение — фотографию, иллюстрацию, даже скриншот из графического редактора — и нейросеть «оживляет» его, добавляя движение. Вода начинает рябить, волосы персонажа колышутся на ветру, облака плывут по небу. Этот режим особый интерес вызывает у иллюстраторов и владельцев интернет-магазинов. Ведь один и тот же товарный снимок можно превратить в динамичный баннер за считанные минуты, и кошелёк при этом не станет заметно легче. Раньше подобная анимация требовала работы моушн-дизайнера с After Effects, а это минимум несколько часов ручного труда и приличный чек за услуги. Сейчас же даже обыватель, далёкий от видеопродакшна, справится с задачей.

Зачем переплачивать за нейросети? Экономьте сотни долларов каждый месяц 💸

Оплачивать Midjourney, премиум-версии ChatGPT, видео- и аудио-генераторы по отдельности — это безумно дорого и неудобно. Этот сервис решает проблему! Получите полный пакет премиум-моделей (более 90 топовых нейросетей) по цене одной доступной подписки. Безлимитные возможности, никаких скрытых платежей и сгорающих токенов при активном тарифе.

Перестаньте платить за 10 разных сайтов. Выбирайте выгоду и творите без ограничений 👉 https://clck.ru/3RNCRL

Стоит ли доверять нейросети серьёзные проекты?

Вопрос неоднозначный. Для финального монтажа полнометражного фильма Runway Gen пока не годится — это было бы лукавством. Артефакты в кадре всё ещё всплывают: пальцы у людей иногда «плывут», текстуры на заднем плане могут дёргаться, а физика объектов порой ведёт себя непредсказуемо. Но для промежуточных задач инструмент работает блестяще. Концепт-арт для питча? Без проблем. Визуальная раскадровка будущего рекламного ролика? Легко. Черновая анимация для согласования с заказчиком? За двадцать минут вместо двух дней. Тем более что платформа позволяет итеративно дорабатывать результат, меняя промт и подкручивая параметры генерации.

К тому же в Runway встроен не только генератор видео. Внутри платформы целый набор инструментов: удаление и замена фона на видео, покадровая стилизация (когда нейросеть перерисовывает ролик в заданном художественном стиле), инпейнтинг (дорисовка отдельных участков кадра) и даже генерация изображений, напоминающая по духу работу с Midjourney. Весь этот арсенал объединён единым интерфейсом в браузере, и перескакивать между разными сервисами нет нужды.

Интерфейс и порог входа

Задача не из лёгких — сделать сложную технологию доступной новичку. И всё же Runway с ней справляется довольно достойно. Рабочее пространство выглядит минималистично: слева — панель инструментов, в центре — зона превью, справа — настройки генерации. Никаких запутанных меню в три уровня вложенности. Новичок, впервые открывший платформу, способен создать первый ролик за пять-семь минут. Это не преувеличение — проверено на коллегах, которые до того момента с нейросетями дела не имели вовсе.

Впрочем, за кажущейся простотой прячутся и подводные камни. Чтобы выжать из модели максимум, нужно понимать логику работы с промтами, чувствовать, какие слова «триггерят» нужный визуальный эффект, а какие — уводят результат в странные дебри. Продвинутые пользователи комбинируют текстовый промт с референсным изображением, задают «негативный промт» (то, чего в кадре быть не должно), экспериментируют с параметром «стилистической силы». Всё это — вопрос практики и набитой руки. Да и сами разработчики регулярно публикуют гайды с примерами удачных формулировок.

Ценообразование: бьёт ли по бюджету?

Бесплатный тариф существует, но ожидать от него чудес не стоит. На нём доступно ограниченное количество «кредитов» — внутренней валюты, которая тратится при каждой генерации. Одного ролика в четыре секунды хватит, чтобы оценить качество, но для системной работы придётся раскошелиться. Стандартный план обходится примерно в двенадцать долларов в месяц (на момент написания статьи), Pro-версия — около тридцати пяти. Для серьёзного продакшна есть тариф Unlimited, но там ценник ощутимо кусается. Стоит ли это своих денег? Если сравнивать со стоимостью аналогичной работы, выполненной фрилансером-моушн-дизайнером, то даже Pro-подписка не сильно ударит по кошельку. А вот для хоббиста, который генерирует пару роликов в месяц ради забавы, бесплатного лимита вполне хватит.

Чем Runway Gen отличается от конкурентов?

Рынок генеративного видео за последний год разросся до внушительных масштабов. Pika, Kling, Sora от OpenAI — каждый из этих сервисов борется за внимание аудитории. На самом деле, прямое сравнение довольно сложно провести, потому что модели развиваются стремительно и то, что было актуально три месяца назад, сегодня уже устарело. И всё же у Runway есть несколько козырей. Во-первых, зрелость экосистемы: платформа существует дольше многих конкурентов, и за это время в ней накопился изрядный набор вспомогательных функций. Во-вторых, качество передачи движения — особенно в Gen-3 Alpha — многие профессионалы оценивают выше, чем у аналогов. Ну и, наконец, API для разработчиков, который позволяет встраивать генерацию прямо в собственные приложения и пайплайны. Для студий, строящих автоматизированные цепочки производства контента, это кладезь возможностей.

Но есть и ложка дёгтя. Длительность роликов пока остаётся скромной — те самые четыре-десять секунд на один проход генерации. Конкуренты вроде Kling уже предлагают более длинные клипы, хотя качество там порой уступает. Кроме того, Runway довольно строго модерирует контент: попытки сгенерировать что-то на грани дозволенного быстро натыкаются на фильтры. Для коммерческого использования это скорее плюс, но креативщиков, тяготеющих к провокационной эстетике, такой подход порой раздражает.

Практические сценарии использования

Абстрактные рассуждения о «возможностях нейросети» мало кого вдохновляют, поэтому стоит разложить по полочкам конкретные сценарии. Один из самых востребованных — создание коротких видеороликов для социальных сетей. SMM-менеджеру достаточно подготовить промт, описывающий атмосферу бренда, и через пару минут получить визуальный контент, который раньше потребовал бы выезда съёмочной группы. Следующий популярный сценарий — прототипирование рекламы. Креативный директор может за один вечер нагенерировать десяток разных концепций, показать их клиенту и только после утверждения запускать полноценное производство. Это экономит и время, и нервы.

Отдельно стоит упомянуть образовательный контент. Преподаватели и авторы онлайн-курсов используют Runway для создания наглядных иллюстраций к сложным темам: визуализация исторических событий, анимация научных процессов, атмосферные вставки для удержания внимания аудитории. Да и блогеры, ведущие каналы на YouTube, давно оценили инструмент для генерации вступительных заставок и переходных сцен. Раньше за подобный добротный визуал приходилось платить дизайнеру, а сейчас — достаточно подписки и толики фантазии.

Что ждёт Runway Gen дальше?

Генеративный видеоконтент стоит на пороге грандиозных изменений. Буквально каждые три-четыре месяца модели заметно прибавляют в качестве, и линия прогресса пока не думает выходить на плато. Команда Runway уже анонсировала работу над новым поколением моделей с улучшенной физикой объектов и более длинными клипами. Если темп сохранится, через пару лет генерация тридцатисекундного ролика в кинематографическом качестве станет обыденностью. И те, кто освоит инструмент сейчас — на стадии его бурного роста, — получат неоспоримое преимущество перед конкурентами, которые «подождут, пока всё устаканится».

Не стоит воспринимать Runway Gen как волшебную кнопку «сделай красиво». Это всё-таки инструмент, и, как любой инструмент, результат он выдаёт ровно пропорционально мастерству того, кто им пользуется. Но порог входа у него настолько низкий, а потенциал настолько внушительный, что окунуться в мир генеративного видео определённо стоит. Удачи в экспериментах — первый удачный ролик наверняка запомнится надолго.