Ещё пару лет назад генерация видео по текстовому описанию казалась чем-то из области научной фантастики — инструментом, доступным разве что голливудским студиям с многомиллионными бюджетами. Сегодня же обыватель, не имеющий ни режиссёрского образования, ни навыков работы в After Effects, способен за считаные минуты получить ролик, от которого захватывает дух. Львиная доля заслуг в этой тихой революции принадлежит нейросетевым платформам, и Runway среди них солирует особенно уверенно. Но чтобы не запутаться в интерфейсе и не потратить все бесплатные кредиты впустую, стоит разобраться в тонкостях работы с этим сервисом ещё до первого запуска.

Что такое Runway и почему вокруг столько шума?

Runway ML — это веб-платформа, построенная на собственных генеративных моделях, главная из которых на момент написания статьи носит название Gen-3 Alpha. Дело в том, что создатели сервиса одними из первых сделали ставку не на статичные изображения, а именно на видео. И ставка сыграла. Буквально за пару лет компания прошла путь от малоизвестного стартапа до инструмента, которым пользуются и независимые блогеры, и крупные продакшн-студии. К слову, технологии Runway засветились даже в работе над оскароносным фильмом «Всё везде и сразу», что само по себе говорит о многом. Платформа тяготеет к мультимодальности: помимо генерации видео здесь можно работать с изображениями, удалять фон, расширять кадр и даже обучать собственные стилевые модели. Но именно функция «текст в видео» приковывает внимание большинства новичков.

Регистрация и первые шаги

Начать нужно с создания аккаунта. Процесс довольно стандартный — переходишь на сайт runwayml.com, жмёшь кнопку регистрации и авторизуешься через Google-аккаунт или электронную почту. После этого система сразу начисляет определённое количество бесплатных кредитов (на момент написания — 125 штук), которых хватит на несколько коротких видеороликов. Не стоит относиться к этим кредитам легкомысленно. Ведь каждая генерация их расходует, а восполнить запас без подписки не получится. Интерфейс после входа встречает довольно лаконичной панелью: слева — список доступных инструментов, по центру — рабочая область, сверху — баланс кредитов. Ничего лишнего, никакой наляпистости. И всё же глаза поначалу разбегаются, потому что инструментов набирается больше дюжины.

С какого инструмента начать?

Вопрос не праздный. Многие новички сразу бросаются к генерации видео, но толковый результат приходит к тем, кто сначала понимает логику работы платформы. Первый инструмент, который стоит освоить, — «Text to Image». Это своего рода тренажёр: ты формулируешь промпт, нейросеть генерирует картинку, и по качеству этой картинки становится ясно, насколько хорошо ты умеешь объяснять машине свои желания. А вот уже потом, когда навык составления промптов окрепнет, имеет смысл переходить к главной изюминке — генерации видео через «Text/Image to Video». Отдельно стоит упомянуть инструмент «Remove Background», который работает на удивление чисто и пригодится тем, кто совмещает Runway с другими редакторами.

Целое приключение — в одном телеграм-боте 🌍

Не нужно ничего скачивать, регистрироваться и разбираться в сложных интерфейсах. Открыли Telegram — и вы уже в текстовой ролевой игре с ИИ. Идеально на 10 минут в обеденный перерыв или на целый вечер: история подождёт и продолжится с того же места, где вы остановились.

Открыть бота 👉 https://clck.ru/3Ta8kQ

Как грамотно составить промпт?

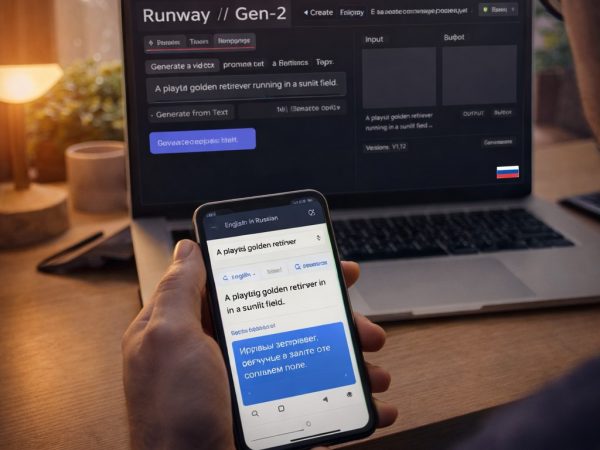

Задача не из лёгких. На самом деле, от промпта зависит процентов восемьдесят итогового результата, а то и больше. Нейросеть Runway воспринимает текст на английском языке (русский тоже формально поддерживается, но результат выходит куда менее предсказуемым). Вся суть хорошего промпта — в конкретике. Вместо размытого «красивый закат над морем» лучше написать что-то вроде «cinematic wide shot of a golden sunset over a calm Mediterranean sea, soft waves, warm color palette, 4K quality». Чем больше деталей — тем точнее попадание. Нужно отметить, что Runway довольно чутко реагирует на стилевые указания: слова «cinematic», «documentary style», «anime», «watercolor» радикально меняют картинку. И всё же не стоит перебарщивать с длиной описания — после двадцати-двадцати пяти слов модель начинает «терять фокус», и часть инструкций попросту игнорируется.

Генерация видео: пошаговый разбор

Кнопка «Generate Video» — та самая, ради которой большинство и регистрируется. После её нажатия открывается рабочее окно, в верхней части которого расположено поле для текстового промпта. Ниже — настройки продолжительности ролика (как правило, от четырёх до десяти секунд на бесплатном тарифе), выбор модели генерации и опция загрузки референсного изображения. Последнее — настоящий спасательный круг для тех, кто хочет получить конкретную визуальную стилистику. Загружаешь картинку, дополняешь её текстовым описанием движения или настроения, и нейросеть анимирует именно этот кадр. Результат порой завораживает. Но бывает и обратная сторона медали: персонажи с «поплывшими» пальцами, нелогичное движение объектов, странная физика воды и ткани. Это нормально. Ведь технология всё ещё молода, и даже лучшие модели спотыкаются на сложных сценах. Средняя генерация занимает от тридцати секунд до двух минут в зависимости от загрузки серверов.

Стоит ли платить за подписку?

Вопрос, который всплывает у каждого, кто израсходовал бесплатные кредиты и остался хотеть большего. Runway предлагает несколько тарифных планов — от базового (примерно двенадцать долларов в месяц) до продвинутого корпоративного. Разница между ними кроется не только в количестве кредитов, но и в максимальном разрешении видео, длительности роликов и приоритете в очереди генерации. Для обывателя, который экспериментирует ради удовольствия или делает короткие ролики для социальных сетей, базового тарифа хватает с головой. А вот если речь идёт о коммерческих проектах или регулярной работе с контентом, кошелёк ощутимо полегчает — придётся брать план Standard или выше. Тем более что на бесплатном тарифе в углу видео красуется водяной знак, который для профессионального использования совершенно неприемлем.

Дополнительные инструменты, о которых забывают

Многие считают Runway исключительно генератором видео, но на самом деле платформа — это целый добротный набор нейросетевых инструментов. Один из самых недооценённых — «Expand Image», позволяющий расширить границы кадра за пределы оригинального изображения. Нейросеть дорисовывает недостающие фрагменты, сохраняя стиль и палитру оригинала. Выглядит это порой настолько органично, что отличить «дорисованное» от настоящего практически невозможно. Следующий полезный инструмент — «Inpainting», с помощью которого можно заменить или удалить любой объект внутри кадра. Достаточно выделить область кистью и описать, чем её заполнить. Ну и, конечно же, нельзя не упомянуть «Frame Interpolation» — функцию, которая добавляет промежуточные кадры в существующее видео, делая движение более плавным. Для тех, кто работает с замедленной съёмкой, — настоящий кладезь возможностей.

Какие ошибки допускают новички?

Первая и самая распространённая — чрезмерная жадность к кредитам. Человек запускает генерацию за генерацией, пытаясь с первого раза получить идеальный результат, и обнаруживает пустой баланс ещё до того, как понял принципы работы инструмента. Вторая ошибка — игнорирование референсных изображений. Без визуальной «подсказки» нейросеть трактует промпт слишком свободно, и результат оказывается далёк от ожиданий. Третья — использование слишком абстрактных описаний. «Сделай красиво» — не промпт. Это пожелание, и довольно расплывчатое. А ещё новички часто забывают про настройки камеры: в Runway можно указать тип движения (панорамирование, наезд, облёт), и этот нюанс кардинально меняет динамику ролика. Впрочем, все эти подводные камни обходятся легко, если потратить час-другой на эксперименты с дешёвыми короткими генерациями перед тем, как браться за серьёзный проект.

Runway и конкуренты: стоит ли выбирать именно его?

На рынке генеративного видео сейчас довольно тесно. Sora от OpenAI, Pika Labs, Kling от Kuaishou — каждый из этих сервисов предлагает свою версию «магии». Но у Runway есть несколько весомых козырей. Во-первых, зрелость продукта: платформа существует с 2018 года и прошла через множество итераций, тогда как многие конкуренты только-только вышли из стадии закрытого тестирования. Во-вторых, экосистемность — все инструменты собраны под одной крышей, и не нужно прыгать между пятью разными сервисами. Ну, а в-третьих, Runway довольно щепетильно относится к качеству генерации: при сравнительном тестировании его ролики часто выигрывают по детализации и реалистичности движения. Конечно, идеального инструмента не существует, и у каждого конкурента найдётся своя изюминка. Но для старта Runway — пожалуй, самый сбалансированный вариант.

Как выжать максимум из бесплатного тарифа?

Хитрость, о которой знают не все. Бесплатные кредиты лучше всего тратить не на генерацию длинных роликов, а на короткие четырёхсекундные фрагменты с последующей склейкой в стороннем видеоредакторе. Так за те же кредиты можно получить в два-три раза больше полезного материала. Кроме того, стоит задуматься о предварительной подготовке референсных изображений — их можно создать в бесплатных генераторах картинок (том же Leonardo AI или Ideogram), а потом скормить Runway для анимации. Это экономит кредиты, потому что нейросети не нужно «придумывать» визуальный стиль с нуля — она работает с уже готовой базой. Да и результат при таком подходе получается куда более предсказуемым. Ещё один совет — не стоит гнаться за максимальным разрешением на этапе черновой генерации. Сначала лучше проверить идею в низком качестве, а уже потом, когда промпт отточен, запускать финальный рендер.

Перспективы и обновления

Runway обновляется с завидной регулярностью. Буквально каждые два-три месяца команда выкатывает новую версию генеративной модели, и каждый раз скачок в качестве бросается в глаза. Если Gen-2, появившийся в 2023 году, создавал довольно «мыльные» и короткие ролики, то Gen-3 Alpha уже выдаёт кинематографичную картинку с внушительной детализацией. А ведь на подходе следующие итерации, обещающие более длинные ролики, лучшее понимание физики и даже поддержку звуковой дорожки. Тем более что конкуренция на рынке подстёгивает разработчиков работать ещё быстрее.

Нейросетевая генерация видео — сфера, которая меняется буквально на глазах, и Runway в ней занимает одну из самых прочных позиций. Даже если сейчас результат кажется несовершенным, через полгода он наверняка удивит. А опыт, накопленный за время экспериментов с промптами и настройками, никуда не денется и пригодится с любым следующим поколением моделей. Удачи в освоении — первые ролики запомнятся надолго.